Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

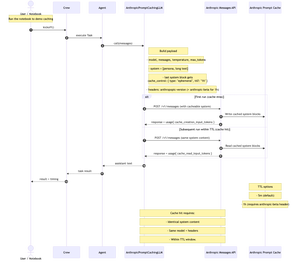

Ik heb zojuist een beknopte, stapsgewijze Jupyter-notebook gepubliceerd die laat zien hoe je een aangepaste LLM voor @crewAIInc kunt bouwen die de Messages API van @AnthropicAI aanroept en prompt caching implementeert.

Wat is prompt caching en wanneer moet je het gebruiken in jouw crew?

Het is een manier om het lange, herhaalde deel van je prompt (meestal systeemcontext) tussen API-aanroepen op te slaan. Je stuurt het één keer, en de daaropvolgende aanroepen hergebruiken het; dit vermindert de invoerkosten met ~90% en versnelt de tijd tot de eerste token met ~85% voor lange prompts, zolang de systeeminhoud + model + headers hetzelfde blijven en je binnen de TTL (5 minuten standaard, 1 uur bèta) blijft.

Dit werkt geweldig voor praatgrage, multi-turn crews. Ook nuttig wanneer jouw crew een lange, stabiele systeemcontext hergebruikt over taken (denk aan: handboek, specificatie, samenvatting van de codebase). Als jouw systeem/context bij elke aanroep verandert, zal caching niet veel helpen.

de kookboek gebruikt "Frankenstein" van Project Gutenberg om caching met echte, lange context te demonstreren.

diagram hieronder: de eerste run schrijft naar de cache; daaropvolgende runs lezen uit de cache wanneer systeeminhoud, model en headers overeenkomen binnen de TTL.

repo + notebook in de reacties.

909

Boven

Positie

Favorieten