Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

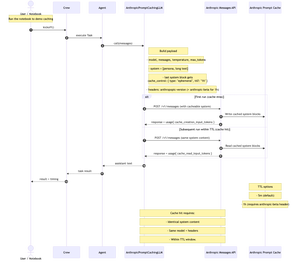

Tôi vừa xuất bản một notebook Jupyter ngắn gọn, từng bước hướng dẫn cách xây dựng một LLM tùy chỉnh cho @crewAIInc, gọi API Messages của @AnthropicAI và thực hiện việc lưu trữ prompt.

Vậy, lưu trữ prompt là gì và khi nào bạn nên sử dụng nó trong nhóm của mình?

Đó là một cách để lưu trữ phần dài, lặp lại của prompt (thường là ngữ cảnh hệ thống) giữa các cuộc gọi API. Bạn gửi nó một lần, sau đó các cuộc gọi tiếp theo sẽ tái sử dụng nó; giảm chi phí đầu vào khoảng 90% và tăng tốc độ thời gian đến token đầu tiên khoảng 85% cho các prompt dài, miễn là nội dung hệ thống + mô hình + tiêu đề vẫn giữ nguyên và bạn nằm trong TTL (mặc định 5 phút, beta 1 giờ).

Điều này hoạt động rất tốt cho các nhóm trò chuyện, nhiều lượt. Cũng hữu ích bất cứ khi nào nhóm của bạn tái sử dụng một ngữ cảnh hệ thống dài, ổn định qua các nhiệm vụ (nghĩ: sổ tay, đặc tả, tóm tắt mã nguồn). Nếu ngữ cảnh/hệ thống của bạn thay đổi mỗi lần gọi, việc lưu trữ sẽ không giúp ích nhiều.

Sách hướng dẫn sử dụng "Frankenstein" từ Project Gutenberg để minh họa việc lưu trữ với ngữ cảnh dài thực tế.

Sơ đồ bên dưới: lần chạy đầu tiên ghi vào bộ nhớ cache; các lần chạy tiếp theo đọc từ bộ nhớ cache khi nội dung hệ thống, mô hình và tiêu đề khớp trong TTL.

916

Hàng đầu

Thứ hạng

Yêu thích