Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

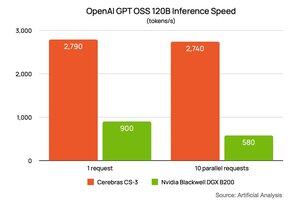

Früher in dieser Woche hat @NVIDIA seine Leistung mit dem gpt-oss-120B Modell von @OpenAI auf dem DGX B200 (8 zwei-die Blackwell-Chips) geteilt. Sie haben @ArtificialAnlys gebeten, eine spezielle Einrichtung für sie vorzunehmen. Sie zeigten eine Leistung von 900 Tokens pro Sekunde für einen Benutzer, die auf 580 Tokens pro Sekunde für 10 Benutzer fiel. Ich habe ihren Link in den Kommentaren unten eingefügt.

Wir haben Artificial Analysis gebeten, dasselbe Setup für uns durchzuführen. Das Ergebnis ist ~2700 Token/s für 1 und dasselbe für 10 Benutzer. Nicht nur ist @CerebrasSystems Inference die schnellste, wir halten die Leistung aufrecht, während Sie Ihre Arbeitslast erhöhen. Cerebras Inference ist heute in voller Produktion und bedient Milliarden von GPT 120B Tokens pro Woche auf @OpenRouterAI, @huggingface und der Cerebras Cloud.

80,1K

Top

Ranking

Favoriten