Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

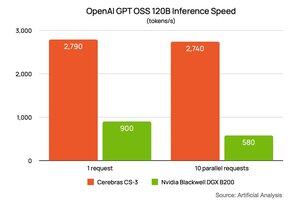

Vào đầu tuần này, @NVIDIA đã chia sẻ hiệu suất của họ trên mô hình gpt-oss-120B của @OpenAI chạy trên DGX B200 (8 chip Blackwell hai die). Họ đã yêu cầu @ArtificialAnlys phân tích để thực hiện một thiết lập đặc biệt cho họ. Họ đã cho thấy hiệu suất đạt 900 token mỗi giây cho một người dùng, và giảm xuống 580 token mỗi giây cho 10 người dùng. Tôi đã dán liên kết của họ trong phần bình luận bên dưới.

Chúng tôi đã yêu cầu Artificial Analysis thực hiện cùng một thiết lập cho chúng tôi. Kết quả là ~2700 token/s cho 1 người và cũng tương tự cho 10 người dùng. Không chỉ @CerebrasSystems Inference là nhanh nhất, mà chúng tôi còn duy trì hiệu suất khi bạn mở rộng khối lượng công việc của mình. Cerebras Inference hiện đang trong sản xuất đầy đủ, phục vụ hàng tỷ token GPT 120B mỗi tuần trên @OpenRouterAI, @huggingface và Cerebras Cloud.

80,08K

Hàng đầu

Thứ hạng

Yêu thích