Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

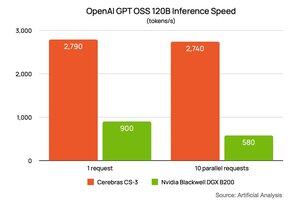

Na początku tego tygodnia @NVIDIA podzieliła się swoimi wynikami na modelu gpt-oss-120B od @OpenAI działającym na DGX B200 (8 chipów Blackwell z dwoma rdzeniami). Poprosili @ArtificialAnlys o przeprowadzenie specjalnej konfiguracji dla nich. Pokazali wydajność 900 tokenów na sekundę dla jednego użytkownika, a spadła do 580 tokenów na sekundę dla 10 użytkowników. W komentarzach poniżej wkleiłem ich link.

Poprosiliśmy Artificial Analysis o przeprowadzenie tej samej konfiguracji dla nas. Wynik to ~2700 tokenów/s dla 1 użytkownika i tyle samo dla 10 użytkowników. Nie tylko @CerebrasSystems Inference jest najszybsze, ale także utrzymujemy wydajność w miarę zwiększania obciążenia. Cerebras Inference jest obecnie w pełnej produkcji, obsługując miliardy tokenów GPT 120B tygodniowo na @OpenRouterAI, @huggingface i Cerebras Cloud.

80,08K

Najlepsze

Ranking

Ulubione