Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

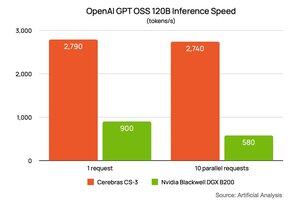

Раніше цього тижня @NVIDIA поділився своєю продуктивністю на моделі @OpenAI gpt-oss-120B, що працює на DGX B200 (8 мікросхем Blackwell з двома кристалами). Вони попросили @ArtificialAnlys аналізі зробити для них спеціальну установку. Вони показали продуктивність 900 токенів в секунду для одного користувача і впали до 580 токенів в секунду для 10 користувачів. Я вставив їх посилання в коментарях нижче.

Ми попросили компанію «Штучний аналіз» виконати для нас таку ж установку. Результат становить ~2700 токенів/с для 1 і стільки ж для 10 користувачів. @CerebrasSystems Inference не лише найшвидший, але й підтримуємо продуктивність, коли ви збільшуєте робоче навантаження. Сьогодні Cerebras Inference знаходиться в повному виробництві, обслуговуючи мільярди токенів GPT 120B на тиждень на @OpenRouterAI , @huggingface та Cerebras Cloud.

80,1K

Найкращі

Рейтинг

Вибране