Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

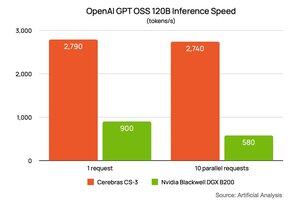

No início desta semana, @NVIDIA compartilhou seu desempenho no modelo gpt-oss-120B da @OpenAI rodando no DGX B200 (8 chips Blackwell de duas matrizes). Eles pediram a @ArtificialAnlys análise para fazer uma configuração especial para eles. Eles mostraram desempenho de 900 tokens por segundo para um usuário e caíram para 580 tokens por segundo para 10 usuários. Eu colei o link deles nos comentários abaixo.

Pedimos à Análise Artificial que executasse a mesma configuração para nós. O resultado é ~ 2700 token / s para 1 e o mesmo para 10 usuários. O @CerebrasSystems Inference não é apenas o mais rápido, mas também sustentamos o desempenho à medida que você aumenta sua carga de trabalho. A Cerebras Inference está em plena produção hoje, atendendo bilhões de tokens GPT 120B por semana no @OpenRouterAI, @huggingface e na Cerebras Cloud.

80,1K

Melhores

Classificação

Favoritos