Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

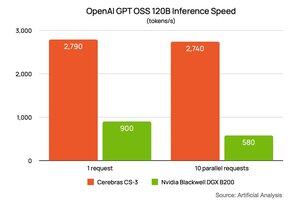

На этой неделе @NVIDIA поделилась своими результатами по модели gpt-oss-120B от @OpenAI, работающей на DGX B200 (8 двухчиповых Blackwell). Они попросили @ArtificialAnlys провести специальную настройку для них. Они показали производительность 900 токенов в секунду для одного пользователя, и она упала до 580 токенов в секунду для 10 пользователей. Я вставил их ссылку в комментариях ниже.

Мы попросили Artificial Analysis провести ту же настройку для нас. Результат составил ~2700 токенов/с для 1 и столько же для 10 пользователей. Не только @CerebrasSystems Inference является самым быстрым, но мы поддерживаем производительность по мере увеличения нагрузки. Cerebras Inference находится в полном производстве сегодня, обслуживая миллиарды токенов GPT 120B в неделю на @OpenRouterAI, @huggingface и в облаке Cerebras.

80,13K

Топ

Рейтинг

Избранное