Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

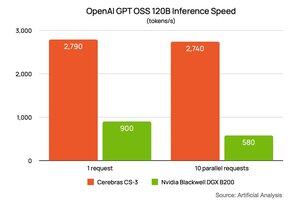

Eerder deze week deelde @NVIDIA zijn prestaties op het @OpenAI gpt-oss-120B model dat draait op DGX B200 (8 twee-die Blackwell chips). Ze vroegen @ArtificialAnlys om een speciale opstelling voor hen te doen. Ze toonden een prestatie van 900 tokens per seconde voor één gebruiker, en dit daalde naar 580 tokens per seconde voor 10 gebruikers. Ik heb hun link in de opmerkingen hieronder geplakt.

We vroegen Artificial Analysis om dezelfde opstelling voor ons uit te voeren. Het resultaat is ~2700 token/s voor 1 en hetzelfde voor 10 gebruikers. Niet alleen is @CerebrasSystems Inference de snelste, we behouden de prestaties naarmate je je werklast opschaalt. Cerebras Inference is vandaag volledig in productie, en bedient miljarden GPT 120B tokens per week op @OpenRouterAI, @huggingface en de Cerebras Cloud.

80,12K

Boven

Positie

Favorieten